De nieuwe Chatbot van Deepseek heeft een indrukwekkende introductie: "Hallo, ik ben gemaakt zodat je alles kunt vragen en een antwoord kunt krijgen dat je misschien zelfs zou verrassen." Deze AI, een product van de Chinese startup Deepseek, is snel een belangrijke marktspeler geworden en heeft zelfs bijgedragen aan een aanzienlijke daling van de aandelenkoers van Nvidia. Het succes ervan komt voort uit een unieke architectuur- en trainingsmethode, met verschillende innovatieve technologieën.

Multi-token voorspelling (MTP): in tegenstelling tot traditionele voorspelling van het woord voor woord voorspelt MTP meerdere woorden tegelijkertijd, waarbij zinsegmenten worden geanalyseerd voor verbeterde nauwkeurigheid en efficiëntie.

Mix van experts (MOE): deze architectuur maakt gebruik van meerdere neurale netwerken om invoergegevens te verwerken, AI -training te versnellen en prestaties te stimuleren. Deepseek V3 gebruikt 256 netwerken en activeert acht voor elk token.

Multi-head latente aandacht (MLA): dit mechanisme richt zich op cruciale zinselementen. MLA extraheert herhaaldelijk belangrijke details, waardoor het risico op het over het hoofd wordt gezien van belangrijke informatie en het verbeteren van genuanceerd begrip.

Deepseek claimde aanvankelijk een opmerkelijk lage trainingskosten van $ 6 miljoen voor zijn krachtige Deepseek V3 -model, met slechts 2048 GPU's. Semianyse onthulde echter een veel grotere infrastructuur: ongeveer 50.000 Nvidia Hopper GPU's (inclusief 10.000 H800s, 10.000 H100s en extra H20's) verspreid over meerdere datacenters. Dit vertegenwoordigt een totale serverinvestering van ongeveer $ 1,6 miljard, met operationele kosten geschat op $ 944 miljoen.

Deepseek, een dochteronderneming van het hoogvlieger hedgefonds, bezit zijn datacenters en biedt volledige controle over optimalisatie en snellere innovatie-implementatie. Deze zelf gefinancierde aanpak verbetert de flexibiliteit en de besluitvormingssnelheid. Bovendien trekt het bedrijf toptalent aan, waarbij sommige onderzoekers jaarlijks meer dan $ 1,3 miljoen verdienen, voornamelijk van Chinese universiteiten.

Het cijfer van $ 6 miljoen lijkt daarom een aanzienlijk understatement te zijn, dat alleen GPU-kosten voor de training vertegenwoordigt. De werkelijke investering in AI -ontwikkeling is groter dan $ 500 miljoen. Desondanks maakt de gestroomlijnde structuur van Deepseek een efficiënte implementatie van innovatie mogelijk in vergelijking met grotere, meer bureaucratische bedrijven.

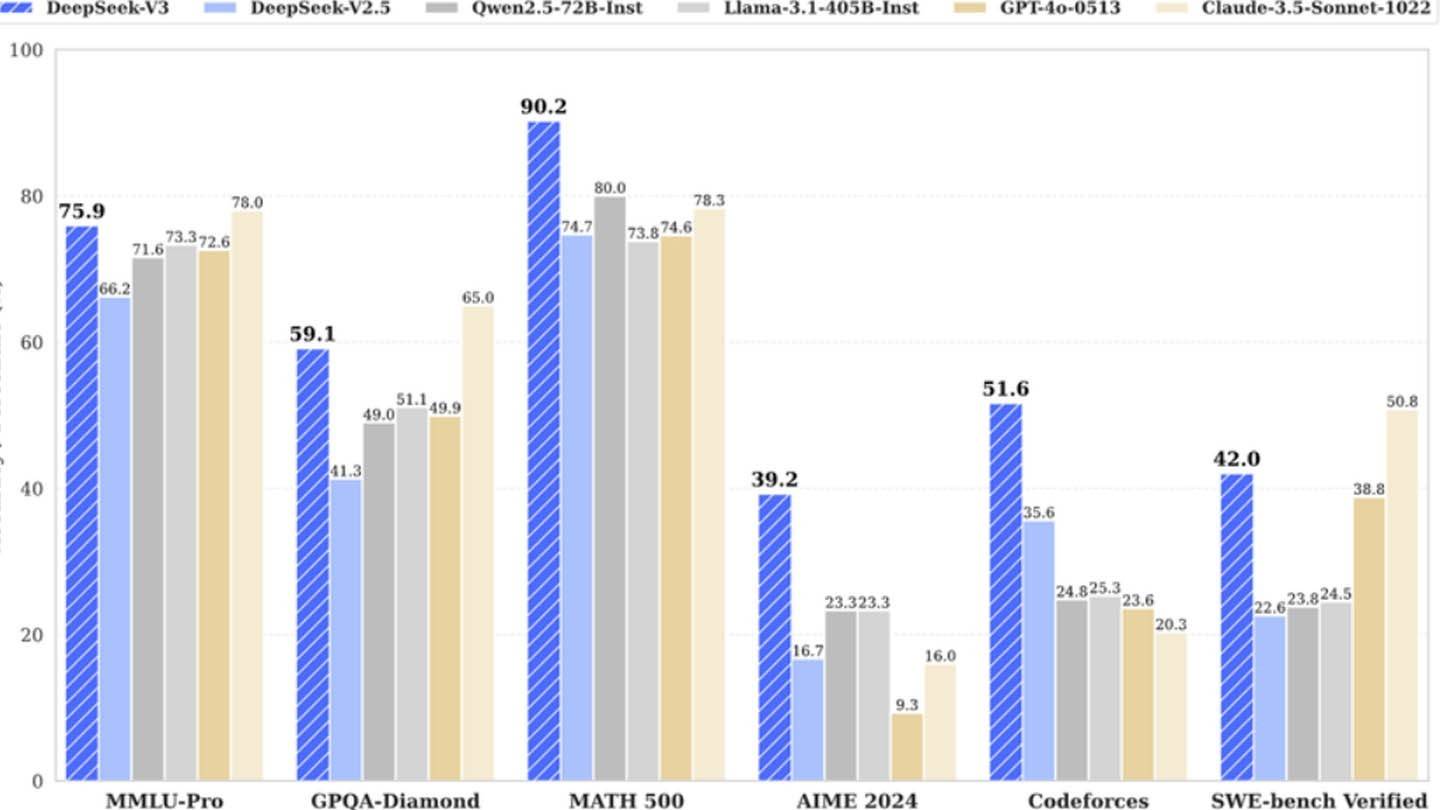

Het succes van Deepseek toont het potentieel van een goed gefinancierd onafhankelijk AI-bedrijf om te concurreren met industriële reuzen. Hoewel de claim "revolutionaire budget" aantoonbaar overdreven is, valt het succes van het bedrijf niet te ontkennen, gevoed door substantiële investeringen, technologische doorbraken en een zeer bekwaam team. Het contrast is opvallend bij het overwegen van de kosten van concurrenten; Het R1 -model van Deepseek kost $ 5 miljoen, terwijl Chatgpt4 $ 100 miljoen kostte. Zelfs met de verduidelijkte kosten blijft Deepseek aanzienlijk goedkoper dan zijn concurrenten.